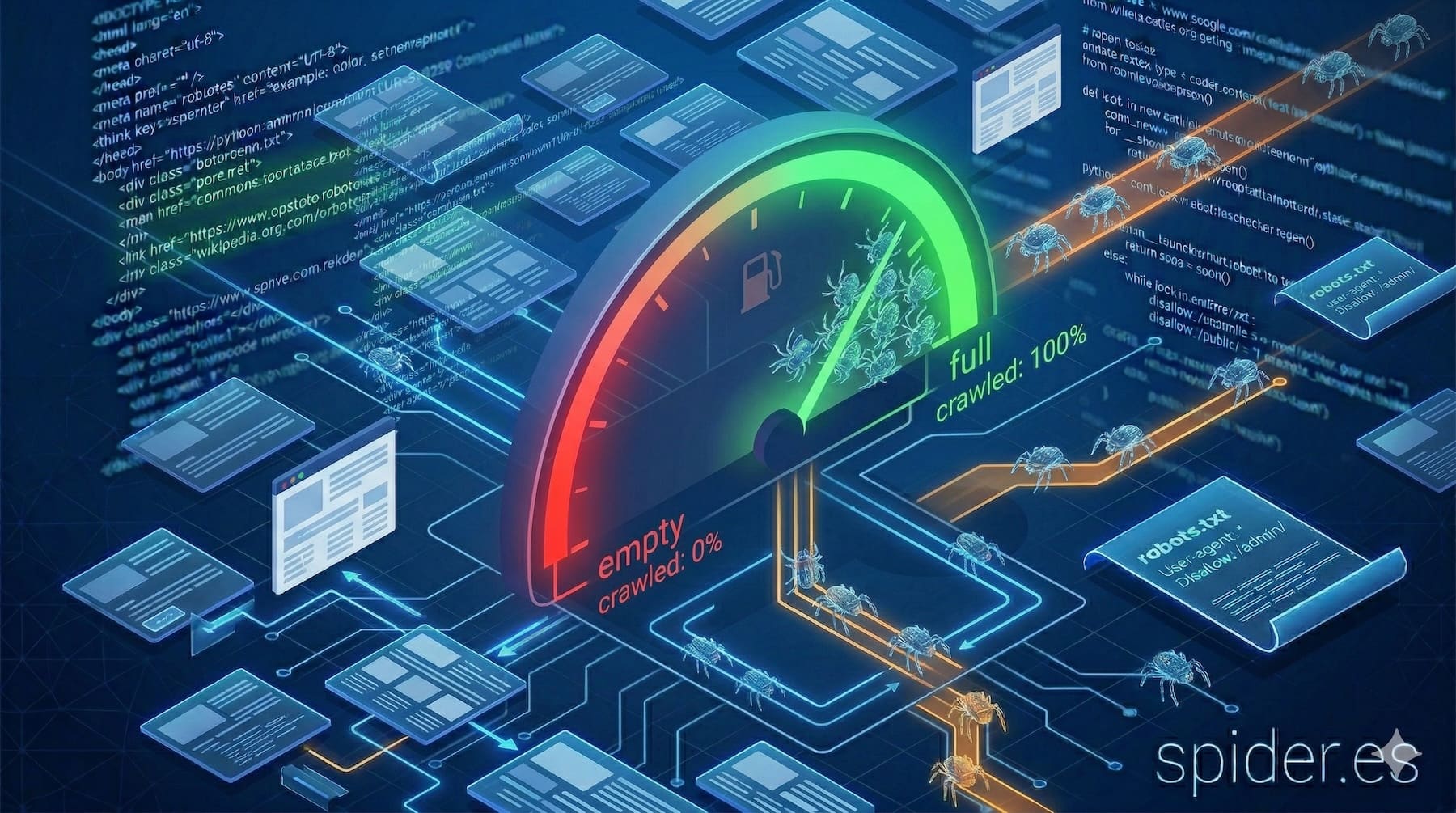

Ottimizzazione del crawl budget: fai contare ogni visita dei bot

I bot dei motori di ricerca non hanno tempo o risorse illimitati. Ogni sito riceve una quantità finita di attenzione dedicata al crawling, e come viene spesa determina quali pagine vengono scoperte, indicizzate e mantenute aggiornate. Questa allocazione finita si chiama crawl budget. Per siti piccoli con poche centinaia di pagine, raramente diventa un collo di bottiglia. Ma per e-commerce, editori di notizie, piattaforme SaaS con contenuti generati dagli utenti o qualsiasi sito che cresca oltre qualche migliaio di URL, l'ottimizzazione del crawl budget è una disciplina SEO fondamentale.

Cos'è veramente il crawl budget

Google definisce il crawl budget come l'intersezione di due fattori:

Limite di frequenza di crawling

Questo è il numero massimo di connessioni simultanee e richieste che Googlebot effettuerà al tuo server senza degradare l'esperienza utente. È determinato dalla velocità di risposta e dalla stabilità del tuo server. Se il server risponde rapidamente con codici di stato 200, la frequenza di crawling aumenta. Se inizia a restituire errori 5xx o a rallentare, Googlebot rallenta automaticamente per evitare di sovraccaricare la tua infrastruttura. Puoi anche regolare la frequenza di crawling in Google Search Console, anche se questo imposta solo un tetto — non forza Googlebot a fare più crawling.

Domanda di crawling

Questa è quanto Google vuole scansionare il tuo sito, guidata da due segnali: popolarità (le pagine con più link in entrata e coinvolgimento degli utenti attraggono più crawling) e obsolescenza (le pagine che cambiano frequentemente vengono ri-scansionate più spesso per mantenere l'indice aggiornato). Una homepage di notizie che si aggiorna ogni dieci minuti riceve molta più domanda di crawling rispetto a una pagina "Chi siamo" immutabile.

Il tuo crawl budget effettivo è il minore dei due. Un server veloce con bassa domanda riceve comunque un crawling modesto. Un sito con alta domanda su un server lento raggiunge il limite di frequenza prima che tutte le pagine importanti siano raggiunte. L'obiettivo dell'ottimizzazione è assicurare che, qualunque sia il budget ricevuto, i bot spendano le loro visite sulle pagine che generano valore di business.

Cosa spreca il crawl budget

Prima di ottimizzare, devi identificare i dreni comuni. Questi sono i problemi che fanno sì che i bot brucino visite su pagine che non aggiungono nulla alla tua presenza nella ricerca.

URL con parametri e navigazione a faccette

Un sito e-commerce con filtri per colore, taglia, fascia di prezzo, marchio e ordinamento può generare milioni di variazioni di URL da poche migliaia di prodotti. URL come /shoes?color=red&size=10&sort=price e /shoes?size=10&color=red&sort=price possono visualizzare contenuti identici con URL diversi. Ognuno consuma uno slot di crawling. Se non controllati, i bot spenderanno la maggior parte del budget scansionando combinazioni di filtri duplicate anziché le pagine prodotto effettive.

Catene di redirect

Quando l'URL A reindirizza all'URL B, che reindirizza a C, che alla fine raggiunge D, il bot ha consumato quattro slot di crawling per una singola destinazione. Le catene spesso si accumulano durante le migrazioni del sito, i cambi di CMS o la ristrutturazione degli URL. Google segue circa 10 redirect prima di rinunciare, ma ogni passaggio è una richiesta sprecata.

Pagine soft 404

Un soft 404 è una pagina che restituisce uno stato 200 OK ma mostra contenuti che dicono "Pagina non trovata" o visualizza un elenco prodotti vuoto. I bot scansionano queste pagine, scaricano l'intero HTML e poi devono capire che il contenuto è inutile. Codici di stato 404 o 410 reali permettono al bot di andare avanti immediatamente. I soft 404 sprecano sia banda che tempo di elaborazione.

Contenuti duplicati senza canonical

ID di sessione negli URL, varianti www vs non-www, versioni HTTP vs HTTPS, slash finali, variazioni di maiuscole/minuscole — tutti questi creano punti di accesso duplicati allo stesso contenuto. Senza tag canonical e redirect adeguati, il bot scansiona ogni variante separatamente, frammentando il tuo budget su pagine identiche.

Spazi infiniti e trappole calendario

Alcune configurazioni CMS creano widget calendario o pattern di paginazione che generano un numero effettivamente infinito di URL. Un calendario che permette di cliccare fino all'anno 2099 crea migliaia di pagine vuote. Allo stesso modo, una funzione di ricerca che espone i suoi risultati come URL scansionabili può generare infinite pagine di basso valore da query generate dai bot.

File media di grandi dimensioni e risorse non ottimizzate

Quando i bot scaricano immagini inutilmente grandi, bundle JavaScript non minificati o video incorporati in ogni pagina, il tempo di trasferimento riduce quante pagine possono raggiungere nella finestra di crawling. Questo è particolarmente impattante quando le risorse pesanti non sono essenziali per comprendere il contenuto della pagina.

Come ottimizzare il crawl budget

Costruisci un'architettura URL pulita

Parti dalle fondamenta. Ogni URL indicizzabile dovrebbe servire contenuti unici e di valore. Implementa questi controlli strutturali:

- Tag canonical su ogni pagina, che puntano alla versione preferita del contenuto.

- Gestione dei parametri: usa il

robots.txtper bloccare combinazioni di parametri note come inutili, o implementa logica lato server che restituisca un tag canonical o un redirect 301 per le variazioni con parametri. - Formato URL coerente: scegli una convenzione (minuscolo, senza slash finale, HTTPS, con o senza

www) e applicala con redirect. - Paginazione con scopo: usa

rel="next"erel="prev"dove supportati, e assicurati che le pagine paginate siano scopribili tramite link interni e sitemap.

Correggi le catene di redirect

Verifica i tuoi redirect e appiattisci le catene in modo che ogni redirect sia un singolo passaggio dalla sorgente alla destinazione finale. Dopo una migrazione del sito, aggiorna i link interni per puntare direttamente ai nuovi URL anziché affidarti alle catene di redirect. Monitora le nuove catene man mano che i contenuti evolvono — tendono ad accumularsi silenziosamente.

Restituisci codici di stato HTTP appropriati

Le pagine eliminate dovrebbero restituire 404 (non trovato) o 410 (rimosso definitivamente). Le pagine spostate dovrebbero restituire 301 (redirect permanente). Le pagine temporaneamente non disponibili dovrebbero restituire 503 con un header Retry-After. Non servire mai un codice 200 per contenuti che non esistono — questo crea soft 404 che sprecano crawl budget e confondono l'indice.

Migliora il tempo di risposta del server

Più veloce è la risposta del tuo server, più pagine i bot possono scansionare entro il limite di frequenza. Leve chiave includono:

- Caching lato server: servi HTML pre-renderizzato per le richieste dei bot quando possibile.

- Distribuzione CDN: riduci la latenza servendo le risposte dai nodi edge vicini alla posizione del bot.

- Ottimizzazione database: query lente che influenzano il tempo di generazione delle pagine riducono direttamente il throughput di crawling.

- Supporto HTTP/2: le connessioni multiplexate migliorano l'efficienza sia per bot che per utenti.

- Monitoraggio TTFB: mantieni il Time To First Byte sotto i 200ms per le pagine critiche.

Cura le tue XML sitemap

Le sitemap sono un segnale diretto ai bot su quali URL contano. Ottimizzale:

- Includendo solo URL indicizzabili e canonical — non elencare mai redirect, pagine noindex o URL bloccati.

- Segmentando le sitemap per tipo di contenuto (prodotti, articoli, categorie) per aiutare i bot a dare priorità.

- Impostando date

<lastmod>accurate — aggiorna solo quando il contenuto cambia genuinamente. Segnali di freschezza falsi erodono la fiducia. - Mantenendo le sitemap sotto 50.000 URL o 50MB per file, usando un indice sitemap per siti più grandi.

- Referenziando le sitemap nel tuo file

robots.txt.

Rafforza i link interni

Le pagine ben collegate tramite link interni vengono scansionate più frequentemente e più rapidamente. Le pagine orfane — quelle senza link interni che puntano ad esse — potrebbero non essere mai scoperte neppure se appaiono in una sitemap. Usa navigazione a breadcrumb, moduli di contenuti correlati, link nel footer e link contestuali nel corpo del testo per creare un grafo di link denso e logico.

Blocca il crawling delle aree di basso valore

Usa il robots.txt per bloccare percorsi che non aggiungono valore alla ricerca: pannelli admin, pagine di login, risultati di ricerca interni, pagine del carrello e duplicati stampabili. Fai attenzione a non bloccare CSS, JavaScript o immagini di cui i bot hanno bisogno per il rendering — questo può danneggiare il tuo posizionamento piuttosto che aiutarlo.

Monitoraggio con i log del server

Il modo più affidabile per capire come i bot interagiscono effettivamente con il tuo sito è l'analisi dei log del server. Search Console fornisce dati utili, ma i log ti danno il quadro completo.

Cosa estrarre dai log

- Identificazione dei bot: filtra le richieste per User-Agent per isolare Googlebot, Bingbot e altri crawler.

- Pagine scansionate al giorno: traccia il totale delle richieste dei bot nel tempo per individuare tendenze e anomalie.

- Distribuzione dei codici di stato: quale percentuale delle richieste bot restituisce 200, 301, 404, 5xx?

- Tempo di risposta per richiesta: identifica le pagine lente che fungono da colli di bottiglia.

- Sezioni più e meno scansionate: confronta l'attenzione dei bot con la priorità di business. Se i bot spendono il 60% delle visite sulle pagine filtro e il 5% sulle pagine prodotto, hai un problema di allocazione del budget.

- Frequenza di crawling per URL: quanto spesso vengono rivisitate le pagine chiave? Le nuove pagine vengono scoperte rapidamente?

Configurare il monitoraggio basato sui log

Inoltra i tuoi log di accesso a una piattaforma di gestione log (ELK stack, Datadog, Splunk o anche un semplice script che analizza il log di accesso). Costruisci dashboard che evidenziano:

- Volume di crawling giornaliero per bot.

- I 50 URL più scansionati.

- URL che restituiscono errori ai bot.

- Tempi di risposta medi e al percentile 95 per le richieste dei bot.

Rivedi queste dashboard settimanalmente. Cali improvvisi nel volume di crawling possono indicare problemi del server, modifiche accidentali al robots.txt o penalizzazioni. I picchi possono segnalare un loop di bot o una trappola di crawling.

Crawl budget e Spider.es

Spider.es simula come i bot dei motori di ricerca sperimentano il tuo sito. Segue i link, legge il robots.txt, controlla i codici di stato, misura i tempi di risposta e mappa il tuo grafo di link interni — dandoti la stessa vista che ha un crawler. Usalo per:

- Identificare le catene di redirect e correggerle prima che si accumulino.

- Trovare pagine orfane che i bot non possono raggiungere tramite il crawling normale.

- Rilevare soft 404 e codici di stato mal configurati.

- Verificare che le tue sitemap contengano solo URL puliti e indicizzabili.

- Misurare i tempi di risposta del server sotto carico di bot simulato.

Considerazioni finali

Il crawl budget non è un numero che puoi trovare in una dashboard — è il risultato emergente delle prestazioni del tuo server, dell'architettura dei contenuti e dei segnali che invii ai motori di ricerca. Ogni catena di redirect, ogni URL con parametri, ogni soft 404 è una visita sprecata su qualcosa che non aggiunge valore. Correggi le perdite, rafforza i segnali e monitora i risultati tramite i log. Quando ogni visita del bot conta, ogni pagina che viene scansionata dovrebbe meritare di essere lì.