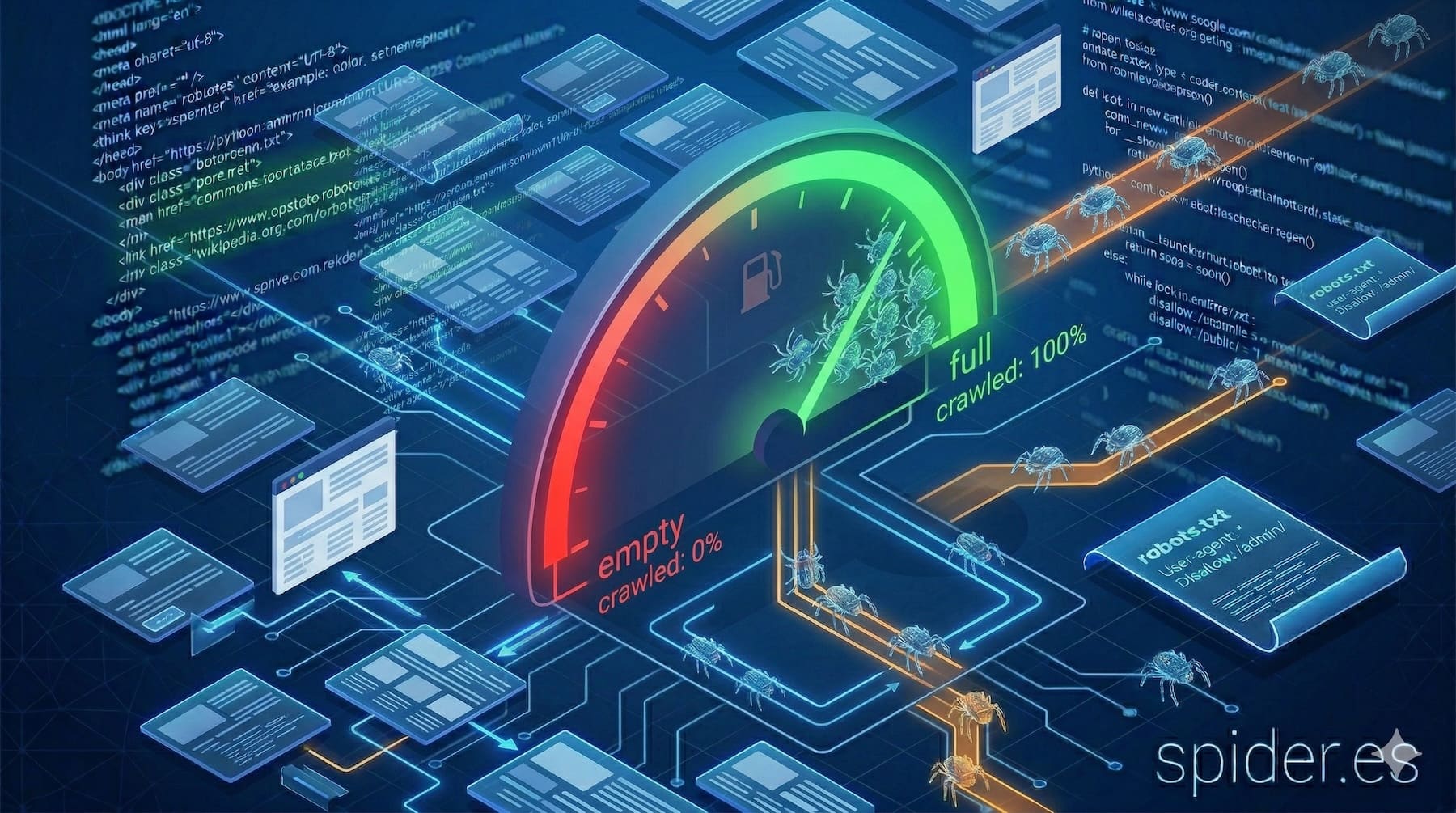

Optimización del crawl budget: haz que cada visita de bot cuente

Los bots de los motores de búsqueda no disponen de tiempo ni recursos ilimitados. Cada sitio recibe una cantidad finita de atención de rastreo, y cómo se invierte esa atención determina qué páginas se descubren, indexan y mantienen actualizadas. Esa asignación finita se denomina crawl budget. Para sitios pequeños con unos cientos de páginas, rara vez se convierte en un cuello de botella. Pero para tiendas online, medios de comunicación, plataformas SaaS con contenido generado por usuarios o cualquier sitio que crezca por encima de unos pocos miles de URLs, la optimización del crawl budget es una disciplina SEO crítica.

Qué es realmente el crawl budget

Google define el crawl budget como la intersección de dos factores:

Límite de velocidad de rastreo (crawl rate limit)

Es el número máximo de conexiones simultáneas y peticiones que Googlebot realizará a tu servidor sin degradar la experiencia del usuario. Está determinado por la velocidad de respuesta y la estabilidad de tu servidor. Si tu servidor responde rápido con códigos 200, la velocidad de rastreo sube. Si empieza a devolver errores 5xx o a ralentizarse, Googlebot reduce automáticamente el ritmo para no sobrecargar tu infraestructura. También puedes ajustar la velocidad de rastreo en Google Search Console, aunque esto solo establece un techo — no obliga a Googlebot a rastrear más.

Demanda de rastreo (crawl demand)

Es cuánto quiere Google rastrear tu sitio, impulsado por dos señales: popularidad (las páginas con más enlaces entrantes e interacción de usuarios atraen más rastreo) y obsolescencia (las páginas que cambian frecuentemente se re-rastrean más a menudo para mantener el índice actualizado). Una portada de noticias que se actualiza cada diez minutos recibe mucha más demanda de rastreo que una página de «Sobre nosotros» que no cambia.

Tu crawl budget efectivo es el menor de estos dos factores. Un servidor rápido con baja demanda sigue recibiendo un rastreo modesto. Un sitio de alta demanda en un servidor lento alcanza el límite de velocidad antes de que se rastreen todas las páginas importantes. El objetivo de la optimización es asegurar que, dentro del presupuesto que recibas, los bots inviertan sus visitas en las páginas que generan valor para el negocio.

Qué desperdicia el crawl budget

Antes de optimizar, necesitas identificar las fugas habituales. Estos son los problemas que hacen que los bots malgasten visitas en páginas que no aportan nada a tu presencia en búsquedas.

URLs con parámetros y navegación por facetas

Un sitio de e-commerce con filtros de color, talla, rango de precio, marca y orden puede generar millones de variaciones de URL a partir de unos pocos miles de productos. URLs como /zapatos?color=rojo&talla=42&orden=precio y /zapatos?talla=42&color=rojo&orden=precio pueden mostrar contenido idéntico con URLs diferentes. Cada una consume una ranura de rastreo. Si no se controla, los bots gastarán la mayor parte de su presupuesto rastreando combinaciones de filtros duplicadas en lugar de las páginas de producto reales.

Cadenas de redirecciones

Cuando la URL A redirige a la URL B, que redirige a la C, que finalmente llega a la D, el bot ha consumido cuatro ranuras de rastreo para un solo destino. Las cadenas suelen acumularse durante migraciones de sitio, cambios de CMS o reestructuraciones de URLs. Google sigue hasta unas 10 redirecciones antes de rendirse, pero cada salto es una petición desperdiciada.

Páginas soft 404

Un soft 404 es una página que devuelve un código 200 OK pero muestra contenido del tipo «Página no encontrada» o un listado de productos vacío. Los bots rastrean estas páginas, descargan todo el HTML y luego tienen que descubrir que el contenido no tiene valor. Los códigos de estado 404 o 410 reales permiten al bot seguir adelante inmediatamente. Los soft 404s desperdician tanto ancho de banda como tiempo de procesamiento.

Contenido duplicado sin canonicals

IDs de sesión en URLs, variantes con o sin www, versiones HTTP vs HTTPS, barras finales, variaciones de mayúsculas y minúsculas — todo esto crea puntos de entrada duplicados al mismo contenido. Sin etiquetas canonical adecuadas y redirecciones, el bot rastreará cada variante por separado, fragmentando tu presupuesto entre páginas idénticas.

Espacios infinitos y trampas de calendario

Algunas configuraciones de CMS crean widgets de calendario o patrones de paginación que generan un número efectivamente infinito de URLs. Un calendario que permite navegar hasta el año 2099 crea miles de páginas vacías. De igual forma, un buscador que expone sus resultados como URLs rastreables puede generar páginas de bajo valor ilimitadas a partir de consultas generadas por bots.

Archivos multimedia grandes y recursos sin optimizar

Cuando los bots descargan imágenes innecesariamente pesadas, paquetes de JavaScript sin minificar o vídeos incrustados en cada página, el tiempo de transferencia reduce cuántas páginas pueden alcanzar dentro de la ventana de rastreo. Esto es especialmente impactante cuando los recursos pesados no son esenciales para entender el contenido de la página.

Cómo optimizar el crawl budget

Construye una arquitectura de URLs limpia

Empieza por los cimientos. Cada URL indexable debe servir contenido único y valioso. Implementa estos controles estructurales:

- Etiquetas canonical en cada página, apuntando a la versión preferida del contenido.

- Gestión de parámetros: usa

robots.txtpara bloquear combinaciones de parámetros basura conocidas, o implementa lógica del lado del servidor que devuelva una etiqueta canonical o una redirección 301 para las variaciones de parámetros. - Formato de URL consistente: elige una convención (minúsculas, sin barra final, HTTPS, con o sin

www) y aplícala con redirecciones. - Paginación con propósito: usa

rel="next"yrel="prev"donde sea compatible, y asegúrate de que las páginas paginadas sean descubribles a través de enlaces internos y sitemaps.

Corrige las cadenas de redirecciones

Audita tus redirecciones y aplana las cadenas para que cada redirección sea un solo salto desde el origen al destino final. Tras una migración de sitio, actualiza los enlaces internos para que apunten directamente a las nuevas URLs en lugar de depender de cadenas de redirecciones. Monitoriza la aparición de nuevas cadenas conforme evoluciona el contenido — tienden a acumularse silenciosamente.

Devuelve códigos de estado HTTP correctos

Las páginas eliminadas deben devolver 404 (no encontrado) o 410 (ya no existe). Las páginas movidas deben devolver 301 (redirección permanente). Las páginas temporalmente no disponibles deben devolver 503 con una cabecera Retry-After. Nunca sirvas un código 200 para contenido que no existe — esto crea soft 404s que desperdician crawl budget y confunden el índice.

Mejora el tiempo de respuesta del servidor

Cuanto más rápido responda tu servidor, más páginas pueden rastrear los bots dentro del límite de velocidad. Las palancas clave incluyen:

- Caché del lado del servidor: sirve HTML pre-renderizado para las peticiones de bots cuando sea posible.

- Despliegue de CDN: reduce la latencia sirviendo respuestas desde nodos edge cercanos a la ubicación del bot.

- Optimización de base de datos: las consultas lentas que afectan al tiempo de generación de página reducen directamente el rendimiento de rastreo.

- Soporte HTTP/2: las conexiones multiplexadas mejoran la eficiencia tanto para bots como para usuarios.

- Monitorización del TTFB: mantén el Time To First Byte por debajo de 200ms en las páginas críticas.

Cuida tus sitemaps XML

Los sitemaps son una señal directa a los bots sobre qué URLs importan. Optimízalos:

- Incluyendo solo URLs indexables y canónicas — nunca listes redirecciones, páginas con noindex o URLs bloqueadas.

- Segmentando los sitemaps por tipo de contenido (productos, artículos, categorías) para ayudar a los bots a priorizar.

- Estableciendo fechas

<lastmod>precisas — actualízalas solo cuando el contenido cambie de verdad. Las señales de frescura falsas erosionan la confianza. - Manteniendo los sitemaps por debajo de 50.000 URLs o 50MB por archivo, usando un sitemap index para sitios más grandes.

- Referenciando los sitemaps en tu archivo

robots.txt.

Refuerza el enlazado interno

Las páginas bien conectadas a través de enlaces internos se rastrean con más frecuencia y más rápido. Las páginas huérfanas — aquellas sin enlaces internos que apunten a ellas — pueden no descubrirse nunca, aunque aparezcan en un sitemap. Usa navegación por migas de pan (breadcrumbs), módulos de contenido relacionado, enlaces en el footer y enlaces contextuales dentro del cuerpo del contenido para crear un grafo de enlaces denso y lógico.

Bloquea el rastreo de áreas de bajo valor

Usa robots.txt para bloquear rutas que no aportan valor a las búsquedas: paneles de administración, páginas de login, resultados de búsqueda interna, páginas del carrito de compra y duplicados de versión para imprimir. Ten cuidado de no bloquear CSS, JavaScript o imágenes que los bots necesitan para el renderizado — esto puede perjudicar tu posicionamiento en lugar de ayudar.

Monitorización con logs del servidor

La forma más fiable de entender cómo los bots interactúan realmente con tu sitio es a través del análisis de logs del servidor. Search Console proporciona datos útiles, pero los logs te dan el panorama completo.

Qué extraer de los logs

- Identificación de bots: filtra las peticiones por User-Agent para aislar Googlebot, Bingbot y otros crawlers.

- Páginas rastreadas por día: monitoriza el total de peticiones de bots a lo largo del tiempo para detectar tendencias y anomalías.

- Distribución de códigos de estado: ¿qué porcentaje de peticiones de bots devuelven 200, 301, 404, 5xx?

- Tiempo de respuesta por petición: identifica las páginas lentas que actúan como cuellos de botella.

- Secciones más y menos rastreadas: compara la atención de los bots con la prioridad del negocio. Si los bots dedican el 60 % de sus visitas a páginas de filtros y el 5 % a páginas de producto, tienes un problema de asignación de presupuesto.

- Frecuencia de rastreo por URL: ¿con qué frecuencia se revisitan las páginas clave? ¿Se descubren las nuevas páginas rápidamente?

Configurar monitorización basada en logs

Envía tus logs de acceso a una plataforma de gestión de logs (ELK stack, Datadog, Splunk o incluso un script simple que analice el access log). Construye paneles que destaquen:

- Volumen diario de rastreo por bot.

- Top 50 de URLs más rastreadas.

- URLs que devuelven errores a los bots.

- Tiempos de respuesta medios y percentil 95 para peticiones de bots.

Revisa estos paneles semanalmente. Las caídas repentinas en volumen de rastreo pueden indicar problemas del servidor, cambios accidentales en robots.txt o penalizaciones. Los picos pueden señalar un bucle de bot o una trampa de rastreo.

Crawl budget y Spider.es

Spider.es simula cómo los bots de los motores de búsqueda experimentan tu sitio. Sigue enlaces, lee robots.txt, comprueba códigos de estado, mide tiempos de respuesta y mapea tu grafo de enlaces internos — dándote la misma vista que tiene un crawler. Úsalo para:

- Identificar cadenas de redirecciones y corregirlas antes de que se acumulen.

- Encontrar páginas huérfanas que los bots no pueden alcanzar mediante rastreo normal.

- Detectar soft 404s y códigos de estado mal configurados.

- Verificar que tus sitemaps contienen solo URLs limpias e indexables.

- Medir los tiempos de respuesta del servidor bajo carga de bot simulada.

Reflexiones finales

El crawl budget no es un número que puedas consultar en un panel — es el resultado emergente del rendimiento de tu servidor, la arquitectura de contenido y las señales que envías a los motores de búsqueda. Cada cadena de redirecciones, cada URL con parámetros, cada soft 404 es una visita desperdiciada en algo que no aporta valor. Corrige las fugas, refuerza las señales y monitoriza los resultados a través de los logs. Cuando cada visita de bot cuenta, cada página que se rastrea debería merecer estar ahí.