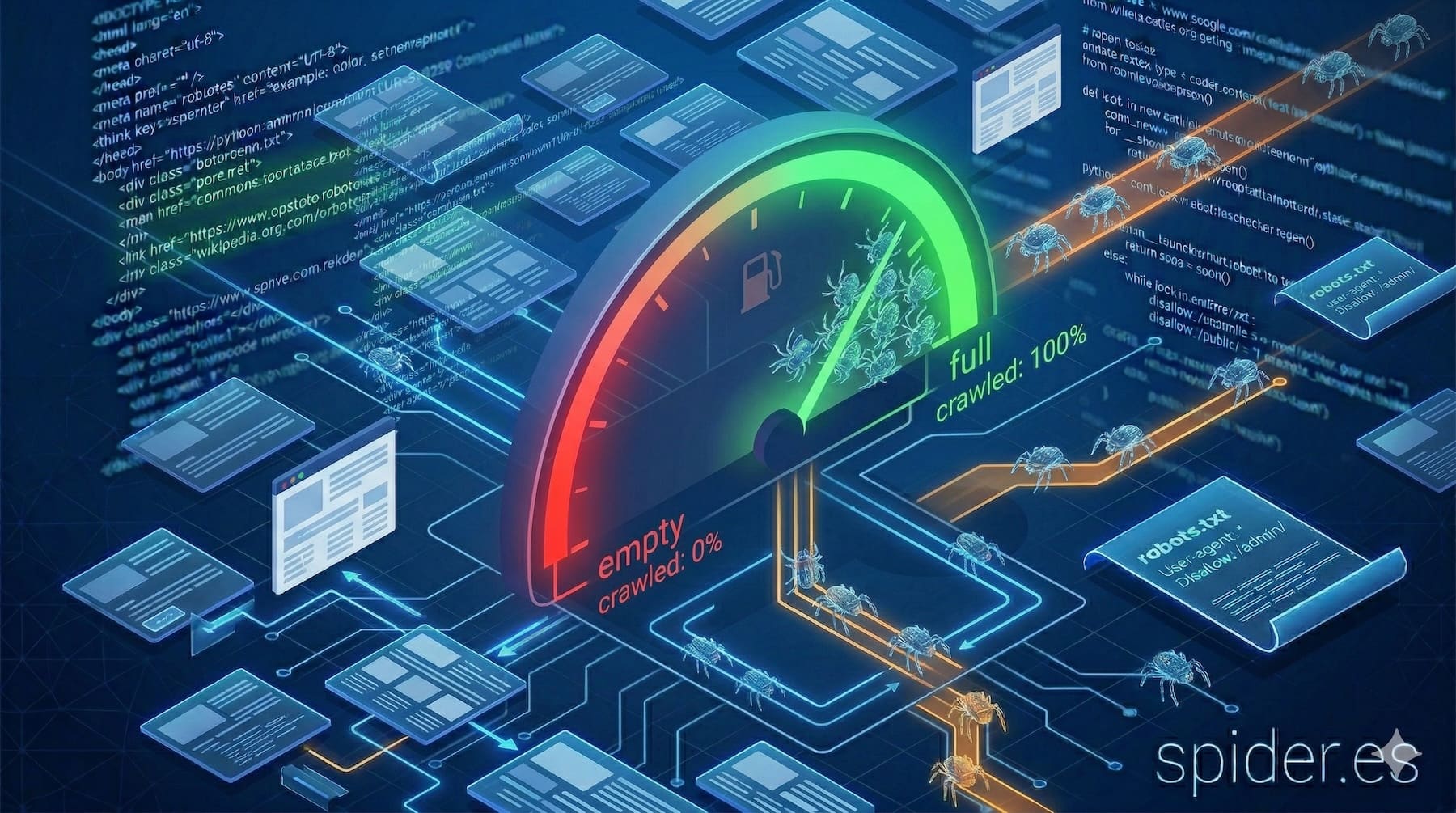

Crawl-Budget-Optimierung: Jeder Bot-Besuch zählt

Suchmaschinen-Bots haben nicht unbegrenzt Zeit oder Ressourcen. Jede Website erhält eine begrenzte Menge an Crawling-Aufmerksamkeit, und wie diese aufgewendet wird, bestimmt, welche Seiten entdeckt, indexiert und aktuell gehalten werden. Diese begrenzte Zuweisung nennt man Crawl-Budget. Für kleine Websites mit wenigen hundert Seiten wird es selten zum Engpass. Aber für E-Commerce-Shops, Nachrichtenverlage, SaaS-Plattformen mit nutzergenerierten Inhalten oder jede Website, die über ein paar tausend URLs hinauswächst, ist die Crawl-Budget-Optimierung eine entscheidende SEO-Disziplin.

Was Crawl-Budget tatsächlich ist

Google definiert Crawl-Budget als die Schnittmenge zweier Faktoren:

Crawling-Rate-Limit

Dies ist die maximale Anzahl gleichzeitiger Verbindungen und Anfragen, die Googlebot an deinen Server stellt, ohne das Nutzererlebnis zu beeinträchtigen. Es wird durch die Antwortgeschwindigkeit und Stabilität deines Servers bestimmt. Antwortet dein Server schnell mit 200-Statuscodes, steigt die Crawling-Rate. Beginnt er, 5xx-Fehler zurückzugeben oder langsamer zu werden, drosselt Googlebot automatisch, um deine Infrastruktur nicht zu überlasten. Du kannst die Crawling-Rate auch in der Google Search Console anpassen, aber das setzt nur eine Obergrenze — es zwingt Googlebot nicht, mehr zu crawlen.

Crawling-Nachfrage

Dies ist, wie sehr Google deine Website crawlen möchte, gesteuert durch zwei Signale: Popularität (Seiten mit mehr eingehenden Links und Nutzer-Engagement ziehen mehr Crawling an) und Veraltung (Seiten, die sich häufig ändern, werden öfter erneut gecrawlt, um den Index aktuell zu halten). Eine Nachrichten-Startseite, die alle zehn Minuten aktualisiert wird, erhält weit mehr Crawling-Nachfrage als eine unveränderliche "Über uns"-Seite.

Dein effektives Crawl-Budget ist das Niedrigere von beiden. Ein schneller Server mit geringer Nachfrage bekommt trotzdem moderates Crawling. Eine Website mit hoher Nachfrage auf einem langsamen Server erreicht das Rate-Limit, bevor alle wichtigen Seiten erreicht sind. Das Ziel der Optimierung ist sicherzustellen, dass Bots ihre Besuche innerhalb des verfügbaren Budgets auf die Seiten verwenden, die Geschäftswert liefern.

Was Crawl-Budget verschwendet

Vor der Optimierung musst du die häufigen Verlustquellen identifizieren. Dies sind die Probleme, die Bots dazu bringen, Besuche auf Seiten zu verbrennen, die deiner Suchpräsenz nichts hinzufügen.

Parameter-URLs und facettierte Navigation

Ein E-Commerce-Shop mit Filtern für Farbe, Größe, Preisbereich, Marke und Sortierung kann Millionen von URL-Variationen aus wenigen tausend Produkten erzeugen. URLs wie /shoes?color=red&size=10&sort=price und /shoes?size=10&color=red&sort=price können identische Inhalte mit unterschiedlichen URLs rendern. Jede verbraucht einen Crawling-Slot. Unkontrolliert werden Bots den Großteil ihres Budgets für das Crawlen doppelter Filterkombinationen statt tatsächlicher Produktseiten aufwenden.

Redirect-Ketten

Wenn URL A zu URL B weiterleitet, die zu C weiterleitet, die schließlich URL D erreicht, hat der Bot vier Crawling-Slots für ein einziges Ziel verbraucht. Ketten entstehen oft bei Website-Migrationen, CMS-Wechseln oder URL-Umstrukturierungen. Google folgt etwa 10 Redirects, bevor es aufgibt, aber jeder Hop ist eine verschwendete Anfrage.

Soft-404-Seiten

Ein Soft 404 ist eine Seite, die einen 200-OK-Status zurückgibt, aber "Seite nicht gefunden" anzeigt oder ein leeres Produktlisting zeigt. Bots crawlen diese Seiten, laden das gesamte HTML herunter und müssen dann herausfinden, dass der Inhalt wertlos ist. Echte 404- oder 410-Statuscodes lassen den Bot sofort weitermachen. Soft 404s verschwenden sowohl Bandbreite als auch Verarbeitungszeit.

Duplicate Content ohne Canonicals

Session-IDs in URLs, www- vs. Non-www-Varianten, HTTP- vs. HTTPS-Versionen, abschließende Schrägstriche, Groß-/Kleinschreibungsvarianten — all dies erzeugt doppelte Zugangspunkte zum selben Inhalt. Ohne korrekte Canonical-Tags und Redirects crawlt der Bot jede Variante separat und fragmentiert dein Budget auf identische Seiten.

Endlose Räume und Kalenderfallen

Manche CMS-Konfigurationen erstellen Kalender-Widgets oder Paginierungsmuster, die eine effektiv unendliche Anzahl von URLs erzeugen. Ein Kalender, der bis ins Jahr 2099 klickbar ist, erzeugt Tausende leerer Seiten. Ebenso kann eine Suchfunktion, die ihre Ergebnisse als crawlbare URLs exponiert, endlose wertarme Seiten aus Bot-ausgelösten Anfragen erzeugen.

Große Mediendateien und nicht optimierte Ressourcen

Wenn Bots unnötig große Bilder, nicht minimierte JavaScript-Bundles oder eingebettete Videos auf jeder Seite herunterladen, reduziert die Transferzeit, wie viele Seiten sie innerhalb des Crawling-Fensters erreichen können. Dies ist besonders wirkungsvoll, wenn die schweren Ressourcen nicht essenziell für das Verständnis des Seiteninhalts sind.

Wie man das Crawl-Budget optimiert

Eine saubere URL-Architektur aufbauen

Beginne mit dem Fundament. Jede indexierbare URL sollte einzigartigen, wertvollen Inhalt liefern. Implementiere diese strukturellen Kontrollen:

- Canonical-Tags auf jeder Seite, die auf die bevorzugte Version des Inhalts zeigen.

- Parameter-Handling: Nutze die

robots.txt, um bekannte wertlose Parameter-Kombinationen zu blockieren, oder implementiere serverseitige Logik, die ein Canonical-Tag oder einen 301-Redirect für Parameter-Variationen zurückgibt. - Konsistentes URL-Format: Wähle eine Konvention (Kleinbuchstaben, ohne abschließenden Schrägstrich, HTTPS, mit oder ohne

www) und setze sie mit Redirects durch. - Paginierung mit Zweck: Nutze

rel="next"undrel="prev"wo unterstützt, und stelle sicher, dass paginierte Seiten über interne Links und Sitemaps auffindbar sind.

Redirect-Ketten beheben

Prüfe deine Redirects und glätte Ketten, sodass jeder Redirect ein einzelner Hop von der Quelle zum endgültigen Ziel ist. Aktualisiere nach einer Website-Migration die internen Links so, dass sie direkt auf die neuen URLs zeigen, anstatt sich auf Redirect-Ketten zu verlassen. Überwache neue Ketten, während sich Inhalte entwickeln — sie neigen dazu, sich stillschweigend anzusammeln.

Korrekte HTTP-Statuscodes zurückgeben

Gelöschte Seiten sollten 404 (nicht gefunden) oder 410 (dauerhaft entfernt) zurückgeben. Verschobene Seiten sollten 301 (permanenter Redirect) zurückgeben. Vorübergehend nicht verfügbare Seiten sollten 503 mit einem Retry-After-Header zurückgeben. Liefere niemals einen 200-Statuscode für Inhalte, die nicht existieren — das erzeugt Soft 404s, die Crawl-Budget verschwenden und den Index verwirren.

Server-Antwortzeit verbessern

Je schneller dein Server antwortet, desto mehr Seiten können Bots innerhalb des Rate-Limits crawlen. Wichtige Hebel sind:

- Serverseitiges Caching: Liefere vorgerendetes HTML für Bot-Anfragen wenn möglich.

- CDN-Einsatz: Reduziere die Latenz, indem Antworten von Edge-Knoten nahe am Bot-Standort ausgeliefert werden.

- Datenbankoptimierung: Langsame Abfragen, die die Seitengenerierungszeit beeinflussen, reduzieren direkt den Crawling-Durchsatz.

- HTTP/2-Unterstützung: Multiplexte Verbindungen verbessern die Effizienz sowohl für Bots als auch für Nutzer.

- TTFB überwachen: Halte die Time To First Byte unter 200ms für kritische Seiten.

XML-Sitemaps kuratieren

Sitemaps sind ein direktes Signal an Bots, welche URLs wichtig sind. Optimiere sie:

- Enthalte nur indexierbare, kanonische URLs — liste niemals Redirects, noindex-Seiten oder blockierte URLs auf.

- Segmentiere Sitemaps nach Inhaltstyp (Produkte, Artikel, Kategorien), um Bots bei der Priorisierung zu helfen.

- Setze genaue

<lastmod>-Daten — aktualisiere nur, wenn sich der Inhalt wirklich ändert. Falsche Frische-Signale untergraben das Vertrauen. - Halte Sitemaps unter 50.000 URLs oder 50MB pro Datei und verwende einen Sitemap-Index für größere Websites.

- Referenziere Sitemaps in deiner

robots.txt-Datei.

Interne Verlinkung stärken

Seiten, die gut durch interne Links verbunden sind, werden häufiger und schneller gecrawlt. Verwaiste Seiten — solche ohne interne Links, die auf sie zeigen — werden möglicherweise nie entdeckt, selbst wenn sie in einer Sitemap erscheinen. Nutze Breadcrumb-Navigation, Module für verwandte Inhalte, Footer-Links und kontextuelle Links im Fließtext, um einen dichten, logischen Linkgraphen zu erstellen.

Crawling wertarmer Bereiche blockieren

Nutze die robots.txt, um Pfade zu sperren, die keinen Suchwert haben: Admin-Panels, Login-Seiten, interne Suchergebnisse, Warenkorb-Seiten und Druckversionen. Achte darauf, keine CSS-, JavaScript- oder Bilddateien zu blockieren, die Bots für das Rendering benötigen — das kann deinen Rankings schaden statt zu helfen.

Monitoring mit Server-Logs

Der zuverlässigste Weg zu verstehen, wie Bots tatsächlich mit deiner Website interagieren, ist die Server-Log-Analyse. Die Search Console liefert nützliche Daten, aber Logs geben dir das vollständige Bild.

Was du aus Logs extrahieren solltest

- Bot-Identifikation: Filtere Anfragen nach User-Agent, um Googlebot, Bingbot und andere Crawler zu isolieren.

- Seiten pro Tag gecrawlt: Verfolge die gesamten Bot-Anfragen im Zeitverlauf, um Trends und Anomalien zu erkennen.

- Statuscode-Verteilung: Welcher Prozentsatz der Bot-Anfragen gibt 200, 301, 404, 5xx zurück?

- Antwortzeit pro Anfrage: Identifiziere langsame Seiten, die als Engpässe wirken.

- Am meisten und am wenigsten gecrawlte Bereiche: Vergleiche die Bot-Aufmerksamkeit mit der Geschäftspriorität. Wenn Bots 60% ihrer Besuche auf Filterseiten und 5% auf Produktseiten verbringen, hast du ein Budget-Zuordnungsproblem.

- Crawling-Häufigkeit pro URL: Wie oft werden Schlüsselseiten erneut besucht? Werden neue Seiten zeitnah entdeckt?

Log-basiertes Monitoring einrichten

Leite deine Zugriffslogs an eine Log-Management-Plattform weiter (ELK Stack, Datadog, Splunk oder auch ein einfaches Skript, das das Zugriffslog parst). Erstelle Dashboards, die Folgendes hervorheben:

- Tägliches Crawling-Volumen pro Bot.

- Die 50 am häufigsten gecrawlten URLs.

- URLs, die Bots Fehler zurückgeben.

- Durchschnittliche und P95-Antwortzeiten für Bot-Anfragen.

Überprüfe diese Dashboards wöchentlich. Plötzliche Einbrüche im Crawling-Volumen können auf Serverprobleme, versehentliche robots.txt-Änderungen oder Abstrafungen hinweisen. Spitzen können auf eine Bot-Schleife oder eine Crawling-Falle hindeuten.

Crawl-Budget und Spider.es

Spider.es simuliert, wie Suchmaschinen-Bots deine Website erleben. Es folgt Links, liest die robots.txt, prüft Statuscodes, misst Antwortzeiten und kartiert deinen internen Linkgraphen — und gibt dir dieselbe Sicht, die ein Crawler hat. Nutze es, um:

- Redirect-Ketten zu identifizieren und zu beheben, bevor sie sich ansammeln.

- Verwaiste Seiten zu finden, die Bots durch normales Crawling nicht erreichen können.

- Soft 404s und fehlkonfigurierte Statuscodes zu erkennen.

- Zu verifizieren, dass deine Sitemaps nur saubere, indexierbare URLs enthalten.

- Server-Antwortzeiten unter simulierter Bot-Last zu messen.

Fazit

Crawl-Budget ist keine Zahl, die du in einem Dashboard nachschlagen kannst — es ist das emergente Ergebnis deiner Server-Performance, Content-Architektur und der Signale, die du an Suchmaschinen sendest. Jede Redirect-Kette, jede Parameter-URL, jeder Soft 404 ist ein verschwendeter Besuch für etwas, das keinen Wert bietet. Behebe die Verluste, stärke die Signale und überwache die Ergebnisse über Logs. Wenn jeder Bot-Besuch zählt, sollte jede Seite, die gecrawlt wird, es verdient haben, dort zu sein.