Otimização de Crawl Budget: Faça Cada Visita de Bot Contar

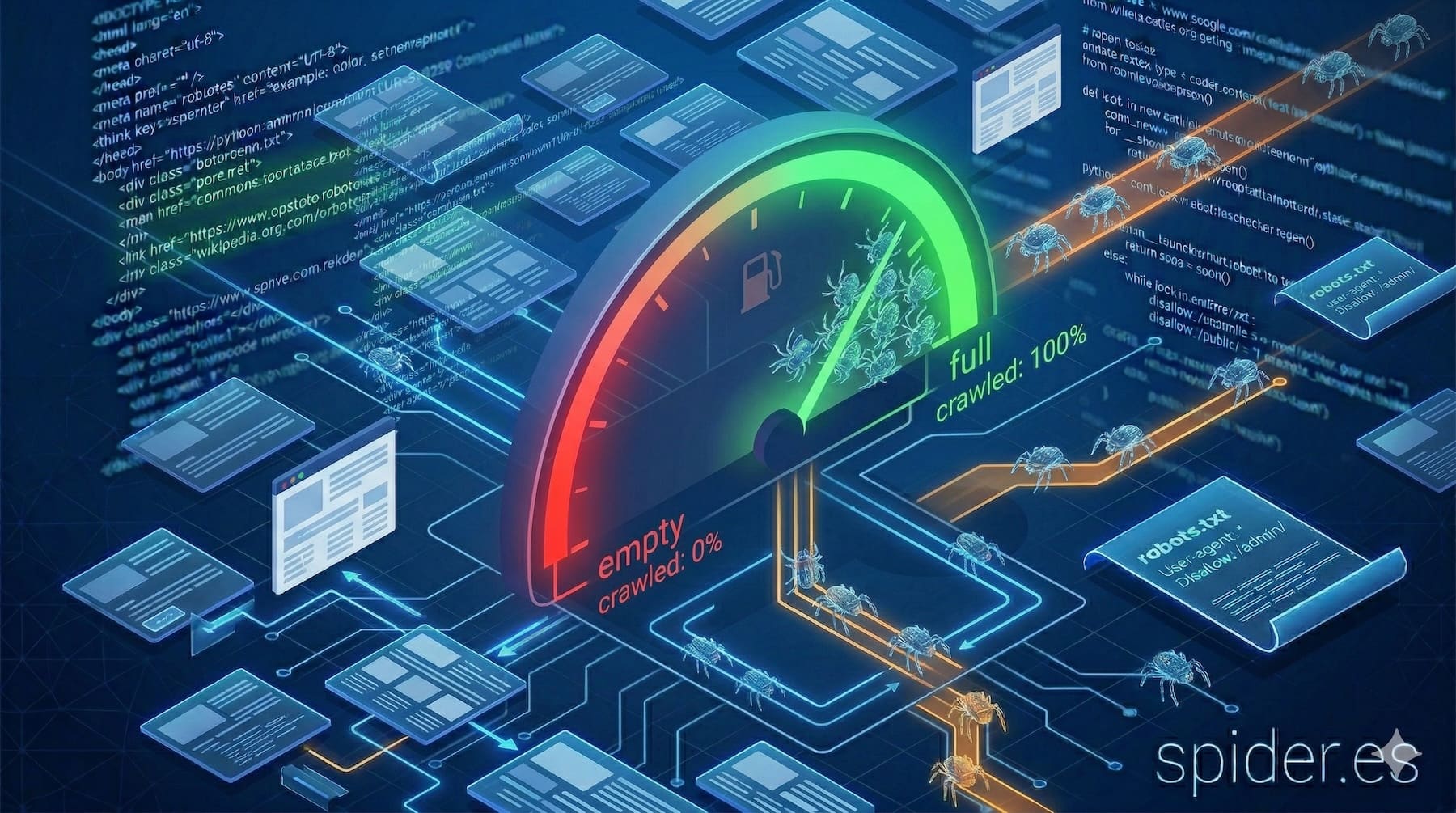

Os bots de mecanismos de busca não têm tempo ou recursos ilimitados. Cada site recebe uma quantidade finita de atenção de rastreamento, e como essa atenção é gasta determina quais páginas são descobertas, indexadas e mantidas atualizadas. Essa alocação finita é chamada de crawl budget. Para sites pequenos com algumas centenas de páginas, raramente se torna um gargalo. Mas para lojas de e-commerce, veículos de notícias, plataformas SaaS com conteúdo gerado por usuários ou qualquer site que cresça além de alguns milhares de URLs, a otimização de crawl budget é uma disciplina crítica de SEO.

O que o crawl budget realmente é

O Google define crawl budget como a interseção de dois fatores:

Limite de taxa de rastreamento

Este é o número máximo de conexões e requisições simultâneas que o Googlebot fará ao seu servidor sem degradar a experiência do usuário. É determinado pela velocidade de resposta e estabilidade do seu servidor. Se seu servidor responde rapidamente com códigos de status 200, a taxa de rastreamento sobe. Se começa a retornar erros 5xx ou ficar lento, o Googlebot automaticamente recua para evitar sobrecarregar sua infraestrutura. Você também pode ajustar a taxa de rastreamento no Google Search Console, embora isso apenas defina um teto — não força o Googlebot a rastrear mais.

Demanda de rastreamento

Este é o quanto o Google quer rastrear seu site, orientado por dois sinais: popularidade (páginas com mais links de entrada e engajamento de usuários atraem mais rastreamento) e obsolescência (páginas que mudam frequentemente são re-rastreadas com mais frequência para manter o índice atualizado). Uma homepage de notícias que atualiza a cada dez minutos recebe muito mais demanda de rastreamento do que uma página "Sobre" estática.

Seu crawl budget efetivo é o menor dos dois. Um servidor rápido com baixa demanda ainda recebe rastreamento modesto. Um site de alta demanda em um servidor lento atinge o limite de taxa antes que todas as páginas importantes sejam alcançadas. O objetivo da otimização é garantir que, dentro do budget que você recebe, os bots gastem suas visitas nas páginas que geram valor para o negócio.

O que desperdiça crawl budget

Antes de otimizar, você precisa identificar os drenos comuns. Estes são os problemas que fazem bots queimarem visitas em páginas que nada adicionam à sua presença na busca.

URLs com parâmetros e navegação facetada

Um site de e-commerce com filtros de cor, tamanho, faixa de preço, marca e ordem de classificação pode gerar milhões de variações de URL a partir de poucos milhares de produtos. URLs como /shoes?color=red&size=10&sort=price e /shoes?size=10&color=red&sort=price podem renderizar conteúdo idêntico com URLs diferentes. Cada uma consome uma vaga de rastreamento. Se não controladas, os bots gastarão a maior parte do seu budget rastreando combinações duplicadas de filtros em vez de páginas reais de produtos.

Cadeias de redirecionamento

Quando a URL A redireciona para a URL B, que redireciona para C, que finalmente chega à URL D, o bot consumiu quatro vagas de rastreamento para um único destino. Cadeias frequentemente se acumulam durante migrações de site, mudanças de CMS ou reestruturações de URL. O Google segue até cerca de 10 redirecionamentos antes de desistir, mas cada salto é uma requisição desperdiçada.

Páginas soft 404

Um soft 404 é uma página que retorna um status 200 OK mas exibe conteúdo que diz "Página não encontrada" ou mostra uma listagem de produtos vazia. Os bots rastreiam essas páginas, baixam o HTML completo e depois precisam descobrir que o conteúdo é inútil. Códigos de status 404 ou 410 reais permitem que o bot siga em frente imediatamente. Soft 404s desperdiçam tanto bandwidth quanto tempo de processamento.

Conteúdo duplicado sem canonicals

IDs de sessão em URLs, variantes www vs não-www, versões HTTP vs HTTPS, barras finais, variações de maiúsculas — todas criam pontos de entrada duplicados para o mesmo conteúdo. Sem tags canonical e redirecionamentos adequados, o bot rastreia cada variante separadamente, fragmentando seu budget entre páginas idênticas.

Espaços infinitos e armadilhas de calendário

Algumas configurações de CMS criam widgets de calendário ou padrões de paginação que geram um número efetivamente infinito de URLs. Um calendário que permite clicar até o ano 2099 cria milhares de páginas vazias. Da mesma forma, uma função de busca que expõe seus resultados como URLs rastreáveis pode gerar páginas ilimitadas de baixo valor a partir de consultas acionadas por bots.

Arquivos de mídia grandes e recursos não otimizados

Quando bots baixam imagens desnecessariamente grandes, bundles de JavaScript não minificados ou vídeos incorporados em cada página, o tempo de transferência reduz quantas páginas eles podem alcançar dentro da janela de rastreamento. Isso é especialmente impactante quando os recursos pesados não são essenciais para entender o conteúdo da página.

Como otimizar o crawl budget

Construa uma arquitetura de URL limpa

Comece pela base. Cada URL indexável deve servir conteúdo único e valioso. Implemente estes controles estruturais:

- Tags canonical em cada página, apontando para a versão preferida do conteúdo.

- Tratamento de parâmetros: use

robots.txtpara bloquear combinações de parâmetros conhecidas como inúteis, ou implemente lógica no servidor que retorne uma tag canonical ou redirecionamento 301 para variações de parâmetros. - Formato de URL consistente: escolha uma convenção (minúsculas, sem barra final, HTTPS, com ou sem

www) e aplique-a com redirecionamentos. - Paginação com propósito: use

rel="next"erel="prev"onde suportados, e garanta que páginas paginadas sejam descobríveis através de links internos e sitemaps.

Corrija cadeias de redirecionamento

Audite seus redirecionamentos e aplaine cadeias para que cada redirecionamento seja um salto único da origem ao destino final. Após uma migração de site, atualize links internos para apontar diretamente para as novas URLs em vez de depender de cadeias de redirecionamento. Monitore novas cadeias conforme o conteúdo evolui — elas tendem a se acumular silenciosamente.

Retorne códigos de status HTTP adequados

Páginas excluídas devem retornar 404 (não encontrado) ou 410 (removido). Páginas movidas devem retornar 301 (redirecionamento permanente). Páginas temporariamente indisponíveis devem retornar 503 com um cabeçalho Retry-After. Nunca sirva um código de status 200 para conteúdo que não existe — isso cria soft 404s que desperdiçam crawl budget e confundem o índice.

Melhore o tempo de resposta do servidor

Quanto mais rápido seu servidor responde, mais páginas os bots podem rastrear dentro do limite de taxa. Alavancas principais incluem:

- Cache no servidor: sirva HTML pré-renderizado para requisições de bots quando possível.

- Implantação de CDN: reduza a latência servindo respostas de edge nodes próximos à localização do bot.

- Otimização de banco de dados: consultas lentas que afetam o tempo de geração de página reduzem diretamente a capacidade de rastreamento.

- Suporte a HTTP/2: conexões multiplexadas melhoram a eficiência tanto para bots quanto para usuários.

- Monitoramento de TTFB: mantenha o Time To First Byte abaixo de 200ms para páginas críticas.

Cuide dos seus sitemaps XML

Sitemaps são um sinal direto para os bots sobre quais URLs importam. Otimize-os:

- Incluindo apenas URLs indexáveis e canônicas — nunca liste redirecionamentos, páginas com noindex ou URLs bloqueadas.

- Segmentando sitemaps por tipo de conteúdo (produtos, artigos, categorias) para ajudar os bots a priorizar.

- Definindo datas

<lastmod>precisas — atualize apenas quando o conteúdo genuinamente mudar. Sinais falsos de frescor corroem a confiança. - Mantendo sitemaps com menos de 50.000 URLs ou 50MB por arquivo, usando um índice de sitemap para sites maiores.

- Referenciando sitemaps no seu arquivo

robots.txt.

Fortaleça a linkagem interna

Páginas bem conectadas através de links internos são rastreadas com mais frequência e rapidez. Páginas órfãs — sem links internos apontando para elas — podem nunca ser descobertas mesmo que apareçam em um sitemap. Use navegação por breadcrumbs, módulos de conteúdo relacionado, links no rodapé e links contextuais no corpo do conteúdo para criar um grafo de links denso e lógico.

Bloqueie o rastreamento de áreas de baixo valor

Use robots.txt para proibir caminhos que não agregam valor à busca: painéis de administração, páginas de login, resultados de busca interna, páginas de carrinho de compras e duplicatas para impressão. Tenha cuidado para não bloquear CSS, JavaScript ou imagens que os bots precisam para renderização — isso pode prejudicar seus rankings em vez de ajudar.

Monitoramento com logs do servidor

A forma mais confiável de entender como os bots realmente interagem com seu site é através da análise de logs do servidor. O Search Console fornece dados úteis, mas os logs dão a imagem completa.

O que extrair dos logs

- Identificação de bots: filtre requisições por User-Agent para isolar Googlebot, Bingbot e outros crawlers.

- Páginas rastreadas por dia: acompanhe o total de requisições de bots ao longo do tempo para identificar tendências e anomalias.

- Distribuição de códigos de status: qual percentual das requisições de bots retorna 200, 301, 404, 5xx?

- Tempo de resposta por requisição: identifique páginas lentas que agem como gargalos.

- Seções mais e menos rastreadas: compare a atenção dos bots com a prioridade do negócio. Se bots gastam 60% das visitas em páginas de filtro e 5% em páginas de produto, você tem um problema de alocação de budget.

- Frequência de rastreamento por URL: com que frequência as páginas-chave são revisitadas? Novas páginas são descobertas prontamente?

Configurando monitoramento baseado em logs

Encaminhe seus logs de acesso para uma plataforma de gerenciamento de logs (ELK stack, Datadog, Splunk ou até um script simples que analise o log de acesso). Construa dashboards que destaquem:

- Volume diário de rastreamento por bot.

- Top 50 URLs mais rastreadas.

- URLs retornando erros para bots.

- Tempos de resposta médio e p95 para requisições de bots.

Revise esses dashboards semanalmente. Quedas repentinas no volume de rastreamento podem indicar problemas no servidor, alterações acidentais no robots.txt ou penalidades. Picos podem sinalizar um loop de bot ou uma armadilha de rastreamento.

Crawl budget e Spider.es

O Spider.es simula como os bots de mecanismos de busca experimentam seu site. Ele segue links, lê o robots.txt, verifica códigos de status, mede tempos de resposta e mapeia seu grafo de links internos — oferecendo a mesma visão que um crawler tem. Use-o para:

- Identificar cadeias de redirecionamento e corrigi-las antes que se acumulem.

- Encontrar páginas órfãs que bots não conseguem alcançar através de rastreamento normal.

- Detectar soft 404s e códigos de status mal configurados.

- Verificar que seus sitemaps contêm apenas URLs limpas e indexáveis.

- Medir tempos de resposta do servidor sob carga simulada de bot.

Considerações finais

O crawl budget não é um número que você pode consultar em um dashboard — é o resultado emergente do desempenho do seu servidor, arquitetura de conteúdo e sinais que você envia aos mecanismos de busca. Cada cadeia de redirecionamento, cada URL com parâmetros, cada soft 404 é uma visita desperdiçada em algo que não agrega valor. Corrija os vazamentos, fortaleça os sinais e monitore os resultados através de logs. Quando cada visita de bot conta, cada página rastreada deveria merecer estar ali.