Comment surveiller les bots qui visitent votre site web

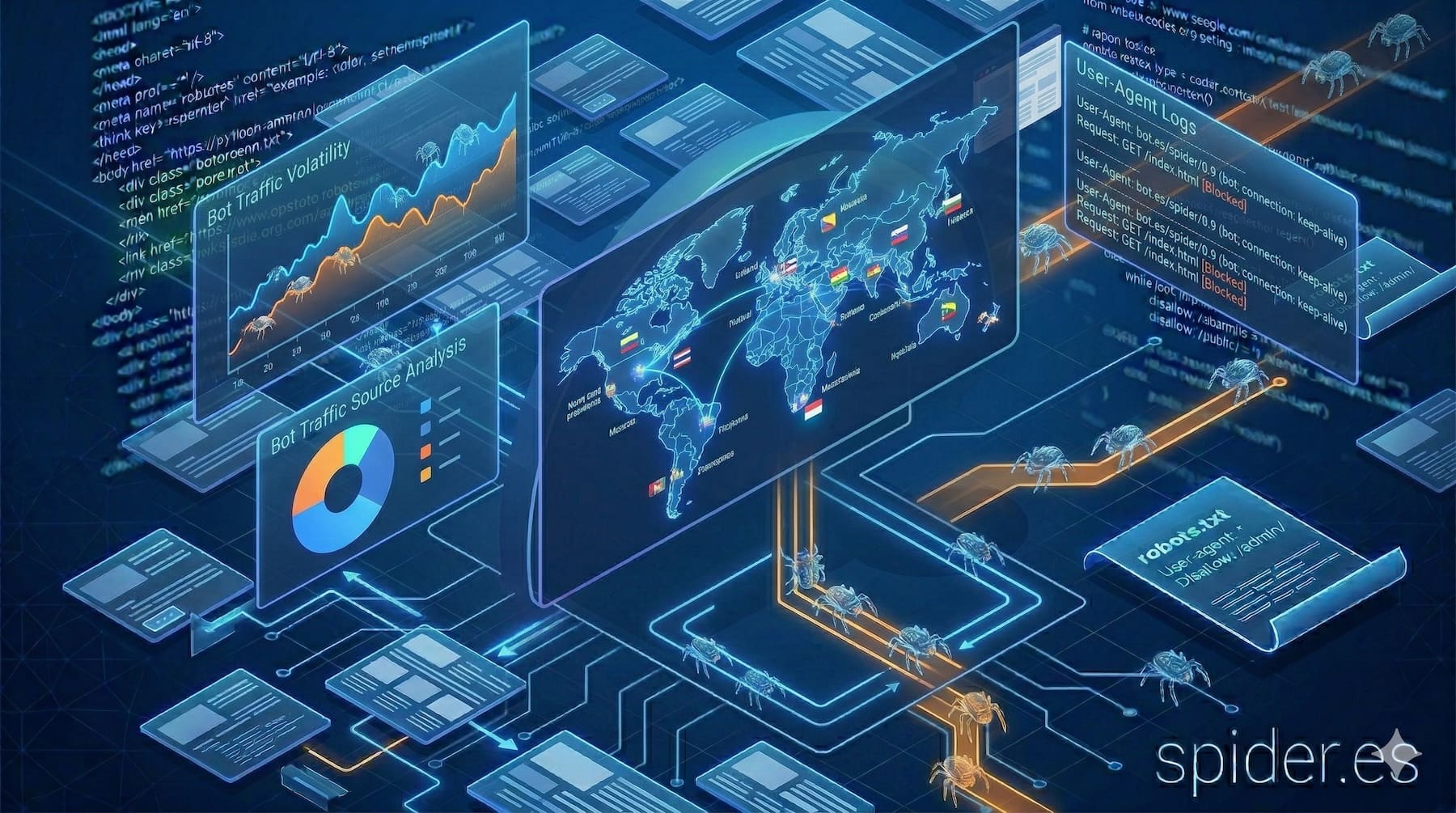

Votre site web reçoit plus de visiteurs que vous ne le pensez — et la plupart ne sont pas humains. Les crawlers de moteurs de recherche, les bots de prévisualisation des réseaux sociaux, les scrapers d'entraînement IA, les outils SEO, les moniteurs de disponibilité et les scrapers malveillants envoient tous des requêtes automatisées à votre serveur en permanence. Savoir qui visite, à quelle fréquence et ce qu'ils font est essentiel pour la sécurité, les performances et le SEO. Ce guide vous accompagne dans les étapes pratiques pour surveiller, vérifier et gérer le trafic bot sur n'importe quel site web.

Pourquoi la surveillance des bots est importante

Le trafic bot représente généralement 30 à 50 % de l'ensemble du trafic web, et sur certains sites, il dépasse le trafic humain. Tous les bots ne sont pas égaux :

- Bots bénéfiques (Googlebot, Bingbot, Applebot) : ils indexent votre contenu et génèrent du trafic organique. Les bloquer par erreur signifie disparaître des résultats de recherche.

- Bots neutres (crawlers SEO comme Screaming Frog ou Ahrefs, moniteurs de disponibilité) : ils servent des objectifs légitimes mais consomment des ressources serveur.

- Bots malveillants (scrapers, credential stuffers, scanners de vulnérabilité, faux crawlers) : ils volent du contenu, attaquent l'infrastructure et faussent les analyses.

Sans surveillance, vous ne pouvez pas faire la différence. Vous pourriez bloquer un crawler légitime qui essaie d'indexer vos nouvelles pages produit, ou servir des milliers de requêtes par heure à un scraper qui clone l'intégralité de votre site.

Analyse des logs serveur : la base

Les logs serveur sont la source la plus fiable de données sur l'activité des bots. Contrairement aux outils d'analyse basés sur JavaScript (que la plupart des bots n'exécutent jamais), les logs serveur capturent chaque requête HTTP quel que soit le client.

Comprendre le format des logs

La plupart des serveurs web utilisent le Combined Log Format par défaut. Une entrée typique ressemble à ceci :

66.249.79.1 - - [31/Mar/2026:14:22:05 +0000] "GET /products/widget HTTP/1.1" 200 12543 "-" "Mozilla/5.0 (compatible; Googlebot/2.1; +http://www.google.com/bot.html)"

Les champs clés pour la surveillance des bots sont :

- Adresse IP (66.249.79.1) — utilisée pour la vérification et la géolocalisation.

- URL demandée (/products/widget) — indique quelles pages les bots visitent.

- Code de statut (200) — révèle les erreurs rencontrées par les bots.

- Chaîne User-Agent — l'identité auto-déclarée du bot.

Filtrer les requêtes des bots

Extrayez le trafic bot en filtrant sur le champ User-Agent. Patterns courants à rechercher :

Googlebot,bingbot,Applebot,DuckDuckBot— moteurs de recherche majeurs.facebookexternalhit,Twitterbot,LinkedInBot,Slackbot— bots de prévisualisation des réseaux sociaux.AhrefsBot,SemrushBot,MJ12bot,DotBot— outils SEO et marketing.GPTBot,ClaudeBot,Google-Extended— bots d'entraînement et de récupération IA.python-requests,curl,wget,Go-http-client— bibliothèques génériques souvent utilisées par des scrapers personnalisés.

Créez un script ou utilisez un outil d'analyse de logs pour regrouper les requêtes par User-Agent, compter les hits quotidiens, lister les URL les plus demandées et suivre la distribution des codes de statut par bot.

Outils d'analyse de logs

Vous n'avez pas besoin de logiciel d'entreprise pour commencer. Options pratiques :

- Outils en ligne de commande :

awk,grep,sortetuniqpeuvent extraire les patterns de trafic bot des fichiers de logs bruts en quelques minutes. - GoAccess : un analyseur de logs en temps réel qui fonctionne dans le terminal ou génère des rapports HTML. Excellent pour des aperçus rapides.

- Stack ELK (Elasticsearch, Logstash, Kibana) : puissant pour l'analyse à grande échelle avec tableaux de bord et alertes.

- Services de logging cloud : Datadog, Splunk, Google Cloud Logging et AWS CloudWatch supportent tous l'ingestion de logs avec des tableaux de bord spécifiques aux bots.

Identifier les bots par User-Agent

La chaîne User-Agent est l'identité auto-déclarée d'un bot. Les crawlers légitimes utilisent des chaînes bien documentées incluant leur nom et une URL avec plus d'informations. Cependant, le User-Agent est trivialement facile à usurper — n'importe quel client HTTP peut le définir à n'importe quelle chaîne.

Cela signifie que le filtrage par User-Agent est utile pour la catégorisation mais insuffisant pour la vérification. Une requête prétendant être Googlebot pourrait provenir d'un scraper dans un data center qui n'a rien à voir avec Google. C'est pourquoi la vérification est une étape distincte et essentielle.

Vérifier les bots légitimes par DNS inversé

La référence pour vérifier qu'un bot est bien celui qu'il prétend être est la résolution DNS inversée suivie d'une confirmation DNS directe. Voici le processus :

Étape 1 : Résolution DNS inversée

Prenez l'adresse IP de l'entrée de log et effectuez une résolution DNS inversée :

host 66.249.79.1

Si le bot est un Googlebot légitime, le résultat sera un nom d'hôte se terminant par .googlebot.com ou .google.com :

1.79.249.66.in-addr.arpa domain name pointer crawl-66-249-79-1.googlebot.com.

Étape 2 : Confirmation DNS directe

Résolvez maintenant ce nom d'hôte en adresse IP :

host crawl-66-249-79-1.googlebot.com

Si l'IP renvoyée correspond à l'originale (66.249.79.1), le bot est vérifié. Si la résolution inversée renvoie un nom d'hôte n'appartenant pas à Google, ou si la résolution directe ne correspond pas, la requête provient d'un imposteur.

Vérification pour les autres moteurs de recherche

Chaque moteur de recherche majeur publie ses noms d'hôte et plages d'adresses IP légitimes :

- Googlebot : noms d'hôte se terminant par

.googlebot.comou.google.com. - Bingbot : noms d'hôte se terminant par

.search.msn.com. - Applebot : plages d'IP publiées par Apple, vérifiables par DNS inversé vers

.applebot.apple.com. - Yandex : noms d'hôte se terminant par

.yandex.com,.yandex.ruou.yandex.net.

Détecter les faux Googlebots

Les faux Googlebots sont un problème persistant. Les scrapers, spammeurs et scanners de vulnérabilité se déguisent fréquemment avec la chaîne User-Agent de Googlebot pour contourner les restrictions d'accès que les webmasters définissent pour les bots inconnus.

Signaux d'alerte des faux Googlebots

- L'adresse IP n'appartient pas au réseau de Google. La vérification DNS inversée est définitive — si le nom d'hôte ne se termine pas par

.googlebot.comou.google.com, ce n'est pas Google. - Patterns d'exploration inhabituels. Le vrai Googlebot respecte le

robots.txt, espace ses requêtes dans le temps et ne martèle pas un seul endpoint. Les faux bots effectuent souvent des requêtes rapides et séquentielles ou ciblent les pages de connexion et les endpoints de formulaires. - Requêtes depuis des plages d'IP résidentielles ou commerciales. Google explore depuis ses propres data centers, pas depuis des FAI, VPN ou fournisseurs cloud qui ne sont pas Google Cloud.

- Absence de comportement de rendu. Le vrai Googlebot exécute le JavaScript. Les faux bots prétendant être Googlebot ne récupèrent généralement que le HTML.

Détection automatisée des faux bots

Pour les sites à fort trafic, la vérification manuelle est impraticable. Automatisez-la en :

- Extrayant toutes les IP prétendant avoir un User-Agent Googlebot depuis vos logs.

- Exécutant des résolutions DNS inversées par lots.

- Signalant toute IP qui ne se résout pas vers un nom d'hôte appartenant à Google.

- Bloquant optionnellement ces IP au niveau du pare-feu ou du WAF.

Utiliser les analytics pour filtrer le trafic bot

Les outils d'analyse basés sur JavaScript comme Google Analytics filtrent naturellement la plupart des bots car ceux-ci n'exécutent généralement pas le JavaScript. Cependant, certains bots sophistiqués exécutent le JS et peuvent polluer vos données avec de fausses sessions, des taux de rebond faussés et des pages vues fantômes.

Étapes pour nettoyer vos analytics

- Activez le filtrage des bots dans Google Analytics (Admin > View Settings > Bot Filtering dans Universal Analytics, ou l'équivalent dans GA4).

- Créez des segments qui excluent les patterns de trafic bot connus : sessions de durée nulle, visites sur des pages honeypot, trafic depuis des ASN de data center.

- Surveillez le spam de référent : les fausses URL de référent qui apparaissent dans vos rapports d'acquisition sont généralement générées par des bots. Filtrez-les par nom d'hôte ou source de référent.

- Croisez avec les logs serveur : si les analytics montrent 10 000 sessions quotidiennes mais que les logs montrent 50 000 requêtes, la différence est largement du trafic bot. Comprendre cet écart vous aide à dimensionner correctement votre infrastructure.

Outils et services de gestion des bots

À mesure que le trafic bot augmente en volume et en sophistication, les solutions dédiées de gestion des bots sont devenues essentielles pour de nombreux sites.

Web Application Firewalls (WAF)

Des services comme Cloudflare, AWS WAF et Sucuri offrent la détection de bots dans leur suite de sécurité. Ils utilisent des bases de données de réputation IP, l'analyse comportementale, des challenges JavaScript et des portes CAPTCHA pour distinguer les bots légitimes des malveillants. La plupart permettent de créer des règles personnalisées qui autorisent les bots de moteurs de recherche vérifiés tout en challengeant ou bloquant tout le reste.

Plateformes dédiées de gestion des bots

Pour les opérations de plus grande envergure, des plateformes comme Cloudflare Bot Management, Akamai Bot Manager et DataDome offrent des capacités avancées : classification des bots par machine learning, fingerprinting d'appareil, tableaux de bord en temps réel et actions de réponse automatisées. Elles sont particulièrement précieuses pour les sites e-commerce confrontés au scraping de prix, à l'accaparement de stocks et aux attaques de prise de compte.

robots.txt et meta robots

N'oubliez pas les fondamentaux. Un fichier robots.txt bien maintenu avec des règles spécifiques par User-Agent, combiné avec des directives meta robots ou X-Robots-Tag pour un contrôle granulaire, reste la première ligne de défense pour gérer les bots bien élevés. Ces mécanismes n'arrêtent pas les bots malveillants (qui ignorent les règles), mais ils sont essentiels pour diriger les crawlers légitimes.

Mettre en place un workflow de surveillance des bots

En rassemblant le tout, voici un workflow pratique de surveillance continue des bots :

- Revue hebdomadaire des logs : vérifiez le volume de trafic bot, les principaux User-Agents, les URL les plus explorées et les taux d'erreur.

- Vérification mensuelle : exécutez des vérifications DNS inversées sur les principales IP prétendant être des bots de moteurs de recherche.

- Audit trimestriel : passez en revue les règles

robots.txt, vérifiez les nouveaux bots à autoriser ou bloquer et confirmez que vos sitemaps sont bien récupérés. - Alertes sur les anomalies : configurez des alertes pour les pics soudains de trafic bot, les taux d'erreur inhabituels ou les nouveaux User-Agents apparaissant en volume.

Comment Spider.es vous aide

Spider.es vérifie comment votre site répond aux accès des crawlers — en validant les règles robots.txt, en testant l'accessibilité des pages et en confirmant que les directives que les bots rencontrent correspondent à vos intentions. En simulant le comportement des bots, il révèle les écarts entre ce que vous pensez que les bots voient et ce qu'ils voient réellement. Utilisez-le en complément de votre analyse de logs pour obtenir une image complète de l'écosystème bot de votre site.

Conclusion

La surveillance des bots n'est pas un audit ponctuel — c'est une pratique continue. Le paysage du trafic automatisé évolue constamment, avec de nouveaux crawlers IA, de nouveaux scrapers et de nouveaux vecteurs d'attaque qui apparaissent régulièrement. Les sites qui maintiennent visibilité, performances et sécurité sont ceux qui savent exactement qui frappe à leur porte et s'il faut les laisser entrer.