Optimisation du crawl budget : rentabilisez chaque visite de bot

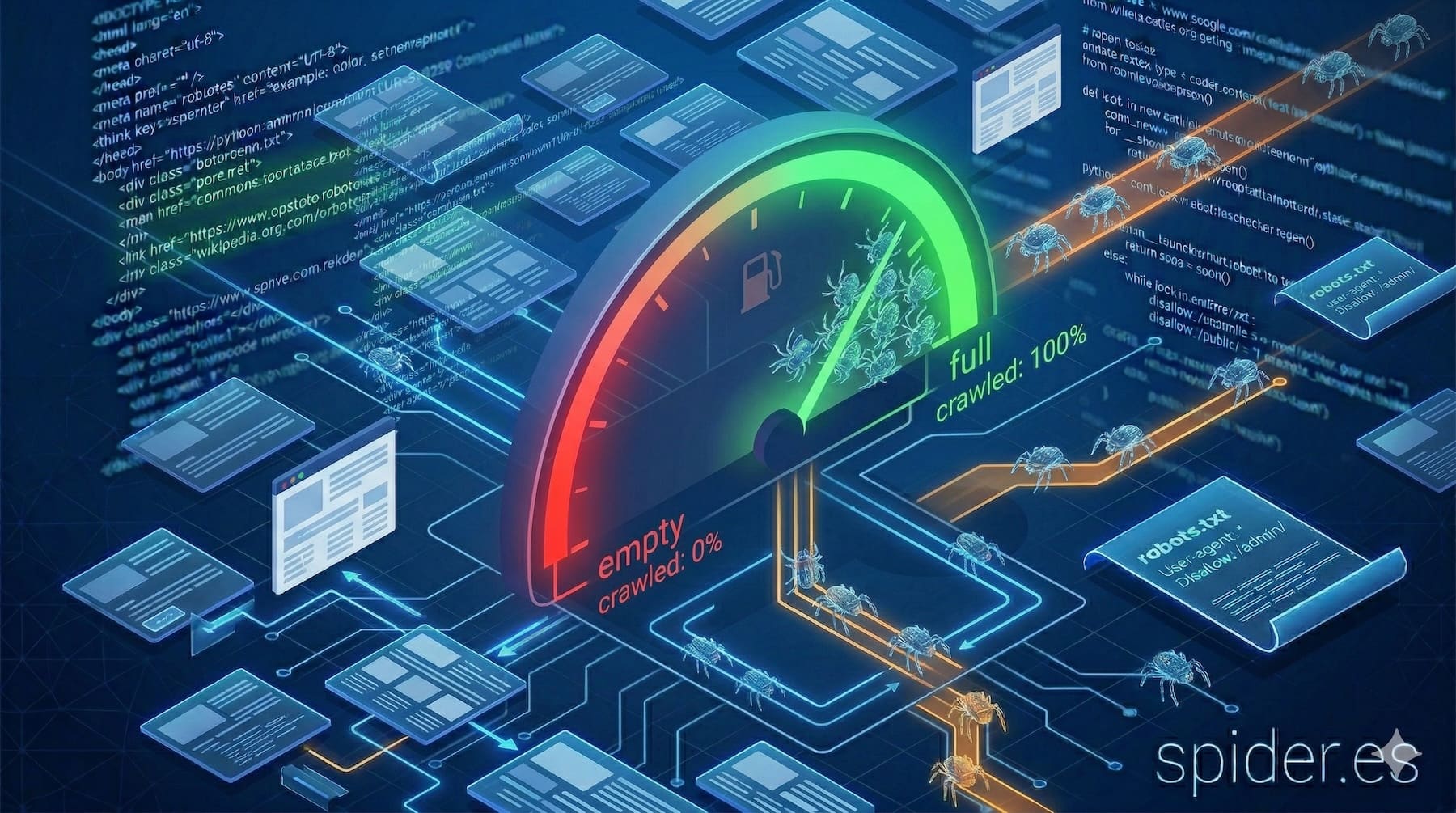

Les bots de moteurs de recherche n'ont ni temps ni ressources illimités. Chaque site reçoit une quantité finie d'attention d'exploration, et la façon dont cette attention est utilisée détermine quelles pages sont découvertes, indexées et maintenues à jour. Cette allocation finie s'appelle le crawl budget. Pour les petits sites de quelques centaines de pages, c'est rarement un goulot d'étranglement. Mais pour les boutiques e-commerce, les éditeurs de presse, les plateformes SaaS avec du contenu généré par les utilisateurs ou tout site dépassant quelques milliers d'URL, l'optimisation du crawl budget est une discipline SEO essentielle.

Ce qu'est réellement le crawl budget

Google définit le crawl budget comme l'intersection de deux facteurs :

Limite de fréquence d'exploration

C'est le nombre maximum de connexions simultanées et de requêtes que Googlebot effectuera sur votre serveur sans dégrader l'expérience utilisateur. Il est déterminé par la vitesse de réponse et la stabilité de votre serveur. Si votre serveur répond rapidement avec des codes de statut 200, la fréquence d'exploration augmente. S'il commence à renvoyer des erreurs 5xx ou à ralentir, Googlebot réduit automatiquement sa cadence pour éviter de surcharger votre infrastructure. Vous pouvez également ajuster la fréquence d'exploration dans Google Search Console, bien que cela ne fixe qu'un plafond — cela ne force pas Googlebot à explorer davantage.

Demande d'exploration

C'est à quel point Google veut explorer votre site, en fonction de deux signaux : la popularité (les pages avec plus de liens entrants et d'engagement utilisateur attirent plus d'exploration) et l'obsolescence (les pages qui changent fréquemment sont ré-explorées plus souvent pour maintenir l'index à jour). La page d'accueil d'un site d'actualités mise à jour toutes les dix minutes reçoit bien plus de demande d'exploration qu'une page « À propos » immuable.

Votre crawl budget effectif est le plus faible des deux. Un serveur rapide avec une faible demande reçoit quand même une exploration modeste. Un site à forte demande sur un serveur lent atteint la limite de fréquence avant que toutes les pages importantes ne soient couvertes. L'objectif de l'optimisation est de s'assurer que, quel que soit le budget reçu, les bots consacrent leurs visites aux pages qui génèrent de la valeur commerciale.

Ce qui gaspille le crawl budget

Avant d'optimiser, vous devez identifier les fuites courantes. Voici les problèmes qui font perdre des visites de bots sur des pages n'apportant rien à votre présence dans les résultats de recherche.

URL à paramètres et navigation à facettes

Un site e-commerce avec des filtres de couleur, taille, gamme de prix, marque et tri peut générer des millions de variations d'URL à partir de quelques milliers de produits. Des URL comme /shoes?color=red&size=10&sort=price et /shoes?size=10&color=red&sort=price peuvent afficher un contenu identique avec des URL différentes. Chacune consomme un créneau d'exploration. Sans contrôle, les bots passeront l'essentiel de leur budget à explorer des combinaisons de filtres dupliquées plutôt que les véritables pages produit.

Chaînes de redirections

Lorsque l'URL A redirige vers l'URL B, qui redirige vers C, qui atteint finalement D, le bot a consommé quatre créneaux d'exploration pour une seule destination. Les chaînes s'accumulent souvent lors des migrations de site, des changements de CMS ou des restructurations d'URL. Google suit environ 10 redirections avant d'abandonner, mais chaque saut est une requête gaspillée.

Pages soft 404

Un soft 404 est une page qui renvoie un statut 200 OK mais affiche un contenu indiquant « Page non trouvée » ou un listing de produits vide. Les bots explorent ces pages, téléchargent le HTML complet puis doivent comprendre que le contenu est sans valeur. De vrais codes de statut 404 ou 410 permettent au bot de passer immédiatement à autre chose. Les soft 404 gaspillent à la fois la bande passante et le temps de traitement.

Contenu dupliqué sans canonicals

Les IDs de session dans les URL, les variantes www vs non-www, les versions HTTP vs HTTPS, les slashs finaux, les variations de casse — tout cela crée des points d'entrée dupliqués vers le même contenu. Sans balises canonical et redirections appropriées, le bot explore chaque variante séparément, fragmentant votre budget sur des pages identiques.

Espaces infinis et pièges de calendrier

Certaines configurations CMS créent des widgets de calendrier ou des patterns de pagination qui génèrent un nombre effectivement infini d'URL. Un calendrier permettant de cliquer jusqu'à l'année 2099 crée des milliers de pages vides. De même, une fonction de recherche qui expose ses résultats comme des URL explorables peut générer des pages de faible valeur sans limite à partir de requêtes déclenchées par les bots.

Fichiers média volumineux et ressources non optimisées

Lorsque les bots téléchargent des images inutilement lourdes, des bundles JavaScript non minifiés ou des vidéos intégrées sur chaque page, le temps de transfert réduit le nombre de pages qu'ils peuvent atteindre dans la fenêtre d'exploration. C'est particulièrement impactant lorsque les ressources lourdes ne sont pas essentielles à la compréhension du contenu de la page.

Comment optimiser le crawl budget

Construire une architecture d'URL propre

Commencez par les fondations. Chaque URL indexable doit servir un contenu unique et de valeur. Mettez en place ces contrôles structurels :

- Balises canonical sur chaque page, pointant vers la version préférée du contenu.

- Gestion des paramètres : utilisez le

robots.txtpour bloquer les combinaisons de paramètres connues comme inutiles, ou implémentez une logique côté serveur qui renvoie une balise canonical ou une redirection 301 pour les variations de paramètres. - Format d'URL cohérent : choisissez une convention (minuscules, sans slash final, HTTPS, avec ou sans

www) et imposez-la via des redirections. - Pagination avec un objectif : utilisez

rel="next"etrel="prev"où c'est supporté, et assurez-vous que les pages paginées sont découvrables via les liens internes et les sitemaps.

Corriger les chaînes de redirections

Auditez vos redirections et aplatissez les chaînes pour que chaque redirection soit un saut unique de la source à la destination finale. Après une migration de site, mettez à jour les liens internes pour pointer directement vers les nouvelles URL plutôt que de dépendre des chaînes de redirections. Surveillez l'apparition de nouvelles chaînes à mesure que le contenu évolue — elles tendent à s'accumuler silencieusement.

Renvoyer les bons codes de statut HTTP

Les pages supprimées doivent renvoyer un 404 (non trouvé) ou 410 (supprimé). Les pages déplacées doivent renvoyer un 301 (redirection permanente). Les pages temporairement indisponibles doivent renvoyer un 503 avec un en-tête Retry-After. Ne servez jamais un statut 200 pour un contenu qui n'existe pas — cela crée des soft 404 qui gaspillent le crawl budget et embrouillent l'index.

Améliorer le temps de réponse du serveur

Plus votre serveur répond vite, plus les bots peuvent explorer de pages dans la limite de fréquence. Leviers essentiels :

- Cache côté serveur : servez du HTML pré-rendu pour les requêtes des bots quand c'est possible.

- Déploiement CDN : réduisez la latence en servant les réponses depuis des nœuds de périphérie proches de la localisation du bot.

- Optimisation de base de données : les requêtes lentes qui affectent le temps de génération des pages réduisent directement le débit d'exploration.

- Support HTTP/2 : les connexions multiplexées améliorent l'efficacité pour les bots comme pour les utilisateurs.

- Surveillance du TTFB : maintenez le Time To First Byte sous 200 ms pour les pages critiques.

Soigner vos sitemaps XML

Les sitemaps sont un signal direct aux bots sur les URL qui comptent. Optimisez-les en :

- N'incluant que des URL indexables et canoniques — ne listez jamais de redirections, de pages noindex ou d'URL bloquées.

- Segmentant les sitemaps par type de contenu (produits, articles, catégories) pour aider les bots à prioriser.

- Définissant des dates

<lastmod>précises — ne les mettez à jour que lorsque le contenu change réellement. De faux signaux de fraîcheur érodent la confiance. - Gardant les sitemaps sous 50 000 URL ou 50 Mo par fichier, en utilisant un sitemap index pour les sites plus importants.

- Référençant les sitemaps dans votre fichier

robots.txt.

Renforcer le maillage interne

Les pages bien connectées par des liens internes sont explorées plus fréquemment et plus rapidement. Les pages orphelines — celles sans aucun lien interne pointant vers elles — peuvent ne jamais être découvertes même si elles apparaissent dans un sitemap. Utilisez la navigation fil d'Ariane, les modules de contenu connexe, les liens de pied de page et les liens contextuels dans le corps du contenu pour créer un graphe de liens dense et logique.

Bloquer l'exploration des zones à faible valeur

Utilisez le robots.txt pour interdire les chemins sans valeur pour la recherche : panneaux d'administration, pages de connexion, résultats de recherche interne, pages de panier et doublons imprimables. Veillez à ne pas bloquer les CSS, JavaScript ou images dont les bots ont besoin pour le rendu — cela peut nuire à vos classements plutôt qu'aider.

Surveillance par les logs serveur

Le moyen le plus fiable de comprendre comment les bots interagissent réellement avec votre site est l'analyse des logs serveur. Search Console fournit des données utiles, mais les logs vous donnent le tableau complet.

Ce qu'il faut extraire des logs

- Identification des bots : filtrez les requêtes par User-Agent pour isoler Googlebot, Bingbot et les autres crawlers.

- Pages explorées par jour : suivez le total des requêtes des bots dans le temps pour repérer les tendances et les anomalies.

- Distribution des codes de statut : quel pourcentage des requêtes des bots renvoient 200, 301, 404, 5xx ?

- Temps de réponse par requête : identifiez les pages lentes qui agissent comme des goulots d'étranglement.

- Sections les plus et les moins explorées : comparez l'attention des bots avec la priorité commerciale. Si les bots passent 60 % de leurs visites sur les pages de filtres et 5 % sur les pages produit, vous avez un problème d'allocation de budget.

- Fréquence d'exploration par URL : à quelle fréquence les pages clés sont-elles revisitées ? Les nouvelles pages sont-elles découvertes rapidement ?

Mettre en place un monitoring basé sur les logs

Redirigez vos logs d'accès vers une plateforme de gestion de logs (stack ELK, Datadog, Splunk ou même un simple script qui analyse le log d'accès). Construisez des tableaux de bord qui mettent en évidence :

- Le volume d'exploration quotidien par bot.

- Les 50 URL les plus explorées.

- Les URL renvoyant des erreurs aux bots.

- Les temps de réponse moyens et au percentile 95 pour les requêtes des bots.

Consultez ces tableaux de bord chaque semaine. Des baisses soudaines du volume d'exploration peuvent indiquer des problèmes serveur, des modifications accidentelles du robots.txt ou des pénalités. Des pics peuvent signaler une boucle de bot ou un piège d'exploration.

Crawl budget et Spider.es

Spider.es simule la façon dont les bots de moteurs de recherche perçoivent votre site. Il suit les liens, lit le robots.txt, vérifie les codes de statut, mesure les temps de réponse et cartographie votre graphe de liens internes — vous offrant la même vision qu'un crawler. Utilisez-le pour :

- Identifier les chaînes de redirections et les corriger avant qu'elles ne s'accumulent.

- Trouver les pages orphelines que les bots ne peuvent pas atteindre par une exploration normale.

- Détecter les soft 404 et les codes de statut mal configurés.

- Vérifier que vos sitemaps ne contiennent que des URL propres et indexables.

- Mesurer les temps de réponse du serveur sous une charge de bot simulée.

Conclusion

Le crawl budget n'est pas un nombre que vous pouvez consulter dans un tableau de bord — c'est le résultat émergent des performances de votre serveur, de votre architecture de contenu et des signaux que vous envoyez aux moteurs de recherche. Chaque chaîne de redirection, chaque URL à paramètres, chaque soft 404 est une visite gaspillée sur quelque chose qui n'apporte aucune valeur. Colmatez les fuites, renforcez les signaux et surveillez les résultats via les logs. Quand chaque visite de bot compte, chaque page explorée devrait mériter de l'être.